Google lanza Ironwood TPU y TSMC muestra una vista previa de las divisiones de octava generación en chips de entrenamiento y estimación a 2 nm

Resumen: Google hizo que Ironwood, su TPU de séptima generación, esté disponible de forma generalizada en Cloud Next 2026 mientras presenta una vista previa de su arquitectura de octava generación: el TPU 8t (Sunfish), un chip de entrenamiento diseñado por Broadcom, y el TPU 8i (Zebrafish), diseñado por MediaTek, ambos previstos para 2026. 2027. Ironwood ofrece 4,6 petaFLOPS y 42,5 exaFLOPS por chip en un SuperPod de 9.216 chips. La división v8 marca la primera vez que Google ha construido chips de inferencia y entrenamiento discretos, y el contrato de Anthropic se extiende a 3,5 gigavatios de computación en 2027, lo que lo convierte en el cliente ancla para ambas generaciones.

Google puso su unidad de procesamiento de tensores de séptima generación, Ironwood, a disposición general de los clientes de la nube el martes en Google Cloud Next en Las Vegas, posicionando el chip como "El primer TPU de Google para la era de la especulacióny es la pieza central de la inversión en infraestructura más agresiva en la historia de la empresa. Ironwood ofrece 4,6 petaFLOPS de cálculo máximo del FP8 por chip, casi cuatro veces el rendimiento de su predecesor Trillium, con 192 GB de memoria HBM3e y 7,37 superbandas de 7,37 segundos de memoria Ironwood. Vincular 9.216 chips en un sistema unificado que ofrece 42,5 exaFLPS de cómputo, más de 24 veces la potencia de El Capitán, actualmente la supercomputadora más poderosa del mundo.

Los números posicionan al Ironwood como un competidor directo del Blackwell B200 de Nvidia en especificaciones brutas. Ambos chips proporcionan aproximadamente entre 4,5 y 4,6 petaFLOPS de cálculo FP8 y 192 GB de HBM. Nvidia lidera el ancho de banda de interconexión de un solo dispositivo, con 14,4 terabits por segundo sobre EnviLink en comparación con los 9,6 terabits de Ironwood sobre ICI, y admite la precisión del FP4, que duplica el rendimiento de estimación para modelos cuantificados, una capacidad de la que Ironwood carece. La ventaja de Google está a escala de clúster: la arquitectura SuperPod, su eficiencia energética es casi el doble del rendimiento por vatio de Trillium y 2,8 veces la del H100 de Nvidia, y la economía de ejecutar cargas de trabajo de inferencia en silicio personalizado diseñado específicamente para el trabajo en lugar de publicidad para GPU de uso general.

¿Por qué adivinar, por qué ahora?

El énfasis en las conjeturas en lugar de en la capacitación marca un cambio estratégico. Entrenar un modelo de frontera es un gasto de capital único que se mide en semanas o meses. En teoría, el proceso de ejecutar ese modelo para responder a la consulta de cada usuario es un costo operativo continuo que crece con la demanda y nunca se detiene. Google dice que necesita duplicar su capacidad de servicio de IA cada seis meses para satisfacer la demanda en Gemini, Search, YouTube y Gmail. A esa tasa de crecimiento, el costo de la inferencia se convierte en la variable más importante en la economía de la IA, y la empresa que fabrica el hardware de inferencia más barato y eficiente captura el margen que de otro modo fluiría hacia Nvidia.

Espacio de coworking de TNW City: donde ocurre tu mejor trabajo

Un espacio de trabajo diseñado para el crecimiento, la colaboración y un sinfín de oportunidades de networking en el corazón de la tecnología.

Ironwood es la respuesta de Google. Es para las cargas de trabajo diseñadas específicamente que dominan la producción de IA: inferencia de modelos de lenguaje grandes, una combinación de arquitecturas expertas, modelos de difusión y aprendizaje por refuerzo. Sus 192 GB de HBM3e por chip le permiten almacenar fragmentos de modelos más grandes en la memoria, lo que reduce la necesidad de distribuir un solo modelo en varios chips. Su matriz de unidades multiplicadoras de matriz de 256 por 256, que presenta 65.536 operaciones de almacenamiento multiplicado por ciclo, está optimizada para el álgebra lineal densa que representa la mayoría de los cálculos en la aproximación de transformadores. Google está poniendo su tiempo de ejecución distribuido interno Pathway a disposición de los clientes de la nube por primera vez, lo que permite la inferencia de múltiples hosts con escalamiento dinámico en los pods de Ironwood.

Dos chips para la octava generación

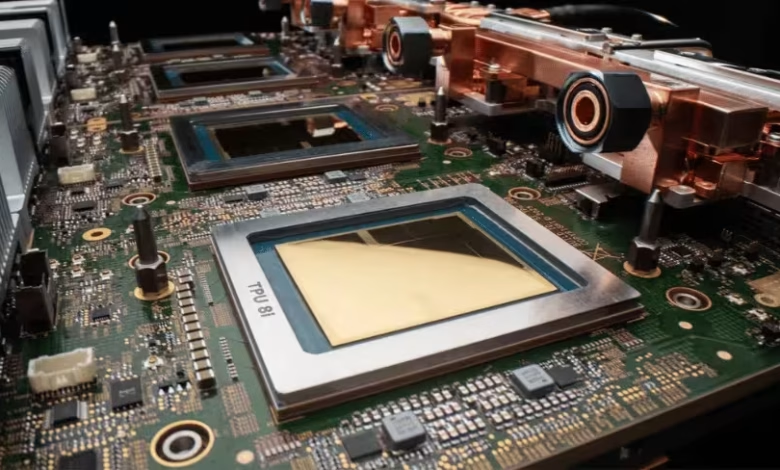

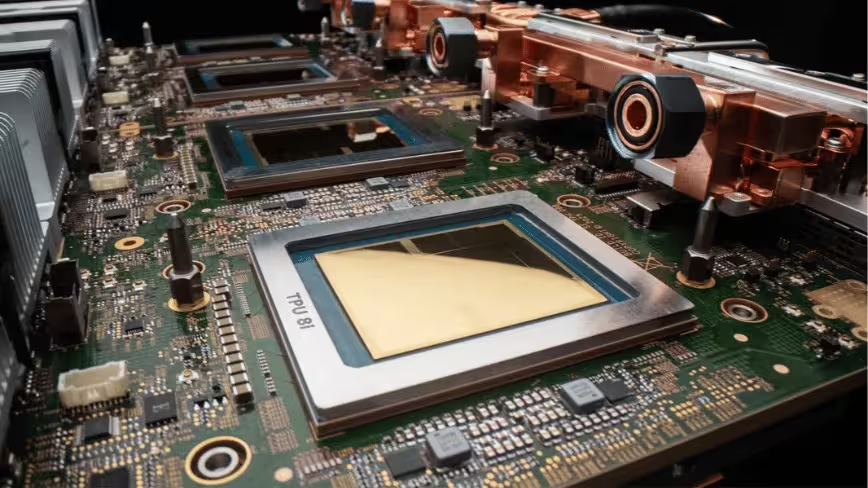

Junto con la disponibilidad general de Ironwood, Google presentó una vista previa de su arquitectura TPU de octava generación y, por primera vez, está dividiendo la línea en dos. TPU 8t, cuyo nombre en código es Sunfish, es un acelerador de entrenamiento diseñado con Broadcom. Tiene dos matrices de cómputo, un chiplet de E/S y ocho pilas de HBM3e de 12 alturas, una actualización de la pila de ocho alturas de Ironwood que proporciona aproximadamente un 30% más de ancho de banda de memoria. TPU 8i, con nombre en código Zebrafish, es un acelerador de inferencia diseñado con MediaTek. Utiliza un único chip de cómputo, un chip de E/S y seis pilas de HBM3e, una configuración simple diseñada para proporcionar estimaciones con un costo entre un 20 y un 30 % menor que la variante de capacitación. Ambos chips se fabricarán en el nodo de proceso de 2 nanómetros de TSMC y están previstos para finales de 2027.

La división es la decisión arquitectónica más importante en la historia de las TPU de Google. Cada generación anterior tenía un chip unificado utilizado tanto para entrenamiento como para estimación. Dividir ambos reconoce una realidad que la industria ha ido aceptando a lo largo de los años: las cargas de trabajo son fundamentalmente diferentes. El procesamiento de billones de parámetros durante semanas de funcionamiento continuo exige la máxima densidad informática y ancho de banda de memoria para el entrenamiento. La inferencia exige rentabilidad y baja latencia para atender miles de millones de consultas por día sin afectar la economía. Diseñar un chip que sea mejor para ambos siempre ha sido un compromiso. Google decidió dejar de hacer concesiones.

La decisión también dejó en suspenso la estrategia de múltiples proveedores. Broadcom opera silicio de entrenamiento de alto rendimiento bajo una relación descrita como un acuerdo de IA por 46 mil millones de dólares. MediaTek ya ha demostrado su capacidad para ofrecer módulos de E/S para Ironwood a costos entre un 20 y un 30 % más bajos que las alternativas, realizando estimaciones de costos optimizados. Según se informa, MediaTek ha solicitado a TSMC un aumento de siete veces en la capacidad de empaquetado avanzado de CoWoS para cumplir con los pedidos de Google. Anthropic, cuyo contrato se extiende a 3,5 gigavatios de computación en línea en 2027, estará entre los primeros clientes de ambas variantes.

La cadena de suministro detrás de los chips

La hoja de ruta de octava generación deja claro que la disponibilidad general de Ironwood ya está implícita: Google está construyendo La IA es la cadena de suministro de chips personalizados más diversa de la industria. Broadcom Ironwood y TPU diseñan el chip de entrenamiento 8t en virtud de un contrato que se extiende hasta 2031. MediaTek diseña variantes de costos optimizados con el chip de inferencia TPU 8i y TPU v7e y v8e. Google está en conversaciones con Marvel Un tercero se está convirtiendo en un posible socio de diseño para desarrollar una unidad de procesamiento de memoria y otra TPU centrada en la especulación. Intel proporciona CPU y colabora en el desarrollo de IPU personalizadas. El enfoque de múltiples proveedores brinda a Google ventaja de negociación, redundancia de la cadena de suministro y la capacidad de asignar perfiles de carga de trabajo a cada socio que coincidan con sus fortalezas.

Google proyecta 4,3 millones de envíos de TPU en 2026, 10 millones en 2027 y más de 35 millones en 2028. El gasto de capital para respaldar esto es enorme. Google ha prometido entre 175.000 y 185.000 millones de dólares en gastos de infraestructura para 2026, casi duplicando los 91.400 millones de dólares que gastó en 2025, una cifra que se revisó al alza dos veces al año. Aproximadamente el 60% se destina a servidores y el 40% a centros de datos y equipos de red. Combinado con Microsoft, Meta y Amazon, el gasto total en infraestructura de IA de las grandes tecnologías se acerca a los 700 mil millones de dólares este año.

Lo más importante es el cliente.

Anthropic es el cliente estrella de Ironwood y cada vez más el cliente de nube más importante de Google. La empresa tendrá acceso a un millón de chips de TPU y más de un gigavatio de capacidad para 2026. La primera fase cubre 400.000 unidades Ironwood, valoradas en aproximadamente 10.000 millones de dólares en bastidores terminados de Broadcom. Las 600.000 unidades restantes se alquilan a través de Google Cloud Platform. La asociación ya se ha ampliado: el contrato de Anthropic ahora cubre 3,5 gigavatios de computación que estarán en línea en 2027, lo que también lo posiciona como un cliente ancla para TPU de octava generación. Los ingresos de Anthropic superaron los $ 30 mil millones, frente a aproximadamente $ 9 mil millones a fines de 2025, y se describió a sí mismo como "impulsado por impresionantes ganancias en precio-rendimiento". Mantiene una estrategia informática diversa que incluye GPU de Amazon Trennium y Nvidia. El hecho de que Anthropologie incluso está explorando sus propios diseños de chips personalizados Comprometerse simultáneamente con una implementación de Google TPU de varios gigavatios ilustra tanto la escala de la demanda como el grado en que la economía del hardware de IA se ha convertido en una variable competitiva por derecho propio.

pregunta de nvidia

Ironwood alcanzó disponibilidad general aproximadamente un año después de la arquitectura Blackwell de Nvidia. Durante ese año, todos los principales proveedores de nube aceleraron su programa de silicio personalizado. Amazon valora su negocio de chips personalizados en 50.000 millones de dólares Y exteriormente Trainium ha señalado una venta. Maya 200 de Microsoft, anunciado en enero, afirma tener tres veces el rendimiento FP4 del Trenium 3 de Amazon. Meta continúa desarrollando MTIA. El mercado de ASIC personalizados para IA está creciendo a un ritmo anual del 44,6%, en comparación con el 16,1% de las GPU. Los analistas estiman que los chips personalizados podrían representar el 45% del mercado de chips de IA para 2028, y predicen que la participación de mercado de Nvidia podría caer del 90% a entre el 20 y el 30%.

La respuesta de Nvidia es unirse al ecosistema a través de NVLink Fusion, una estrategia que lo convierte en el estándar predeterminado para interconexiones de silicio personalizado, incluidos chips diseñados para competir con las propias GPU de Nvidia. Jensen Huang hace caso omiso de la amenaza del chip personalizado con su característica confianza: "No es fácil hacer algo mejor". No se equivoca al decir que el ecosistema de software CUDA de Nvidia, las herramientas de desarrollo y los estándares de interconexión crean costos de conmutación que las especificaciones de hardware en bruto no capturan. Pero la dirección del mercado es clara. Los hiperescaladores están construyendo sus propios chips no porque piensen que pueden vencer a Nvidia en todas las métricas, sino porque han llegado a la conclusión de que el silicio de inferencia diseñado específicamente, optimizado para sus cargas de trabajo específicas e implementado en su escala específica, genera una mejor economía que comprar GPU de Nvidia con los márgenes de Nvidia.

Google Cloud ocupa alrededor del 11% del mercado de infraestructura en la nube, detrás de AWS con un 31% y Azure con un 25%, pero sale de 2025 con la tasa de crecimiento más rápida de los tres y el primer período sostenido de rentabilidad. Ironwood no cambia la posición de Google en el mercado de la nube de la noche a la mañana, y la arquitectura Ruby de Nvidia, prevista para finales de 2027, podría recuperar ventajas de rendimiento en memoria y redes que podrían inclinar el costo total de propiedad informática nuevamente a su favor. Pero la dirección a la que se ha comprometido Google ahora es irreversible: una hoja de ruta que se extiende desde el envío actual de Ironwood hasta dos chips de octava generación especialmente diseñados a 2 nanómetros en 2027, 185 mil millones de dólares en gasto anual en infraestructura, una cadena de suministro de cuatro socios y un cliente ancla que es g5 para Anthropic. La carrera de chips es, en última instancia, una carrera por el margen. Google apuesta a que el margen pertenece a la empresa que fabrica el silicio, no a la empresa que lo compra, y ahora está fabricando dos chips donde antes fabricaba uno.